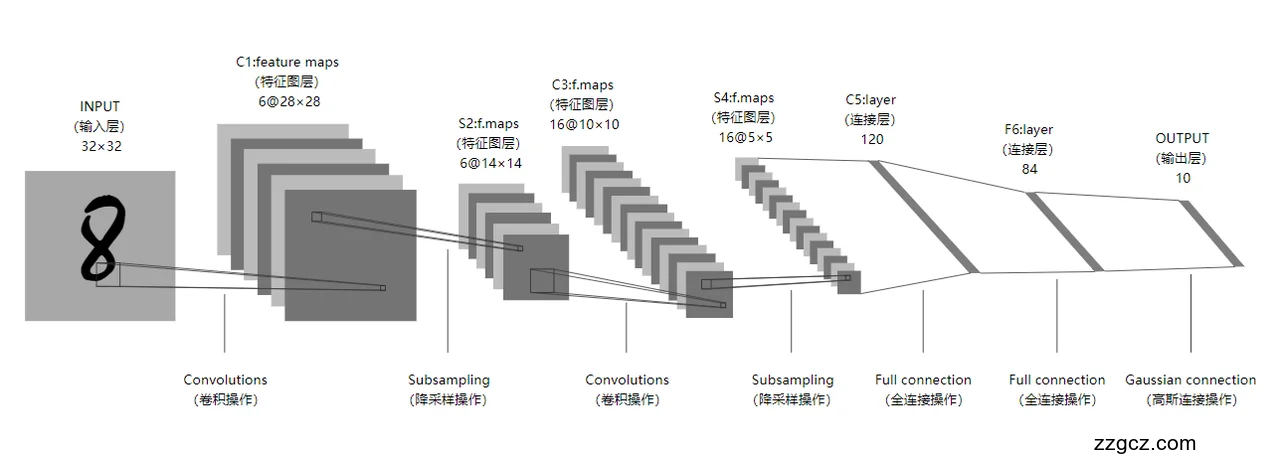

LeNet-5(1998):基于梯度的学习方法在文档识别中的应用

导出时间:2025/11/23 20:18:00

20 世纪 90 年代,计算机已经能识别文本,但图片识别很困难。比如银行支票的手写数字识别,传统方法需要人工设计规则,费时费力且精度不高。

于是,Yann LeCun 及其团队提出了 LeNet-5——一种可以自动从图片中提取特征的卷积神经网络。

1、LeNet-5 的总体思路

1.1 一个生活化比喻

想象你是一个验钞员:

- 拿到一张钞票(输入图片)

- 先用放大镜找细节(卷积层)

- 缩小视野,专注主要花纹(池化层)

- 再看更复杂的组合图案(深层卷积)

- 大脑分析所有线索,判断真假(全连接层 + 分类器)

1.2 模型的三大核心步骤

- 特征提取(卷积层 + 池化层)

- 特征组合(更深的卷积)

- 分类决策(全连接层 + Softmax)

层编号

| 类型

| 输入大小

| 特征图数量

| 卷积核大小

| 输出大小

| 说明

|

输入层

| -

| 32×32×1

| 1

| -

| 32×32×1

| 灰度图像(MNIST 28×28 会补 0 到 32×32)

|

C1

| 卷积层

| 32×32×1

| 6

| 5×5

| 28×28×6

| 提取边缘、角点等基础特征

|

S2

| 平均池化层

| 28×28×6

| 6

| 2×2

| 14×14×6

| 降低分辨率,去掉噪声

|

C3

| 卷积层

| 14×14×6

| 16

| 5×5

| 10×10×16

| 提取更复杂的组合特征

|

S4

| 平均池化层

| 10×10×16

| 16

| 2×2

| 5×5×16

| 再次降维

|

C5

| 卷积层

| 5×5×16

| 120

| 5×5

| 1×1×120

| 全局特征汇总,相当于全连接

|

F6

| 全连接层

| 1×1×120

| 84

| -

| 84

| 类似大脑的中间推理层

|

输出层

| 全连接

| 84

| 10

| -

| 10

| Softmax 分类,输出 0-9 概率

|

2、每一层的作用

2.1 C1 卷积层

- 目标:找到低级特征(边缘、线条、简单形状)

- 操作:6 个 5×5 滤镜,每个滤镜学会不同的模式

- 类比:摄影师用不同滤镜拍摄同一场景,捕捉不同细节

2.2 S2 平均池化层

- 目标:缩小图像尺寸,保留主要信息,减少计算量

- 类比:看缩略图——虽然小了,但主体还在

2.3 C3 卷积层

- 目标:组合前面的低级特征,形成高级特征(曲线、交叉)

- 特别之处:并不是所有输入都连接到每个输出,减少参数量

2.4 S4 平均池化层

- 同 S2,再次降维,减少计算量

2.5 C5 卷积层

- 卷积核大小等于输入大小(5×5),所以每个卷积核看到整个输入

- 相当于全连接,但参数更少

2.6 F6 全连接层

- 把提取到的特征重新组合,准备分类

- 输出 84 个神经元,类似人脑做最后的综合判断

2.7 输出层

- Softmax 输出 10 个概率

- 最高概率对应最终分类结果

3、LeNet-5 的优点与局限

3.1 优点

- 特征自动提取

- 参数量小(~6 万),对硬件要求低

- 思路清晰,是现代 CNN 的模板

3.2 局限

- 激活函数使用 Sigmoid/tanh,训练容易梯度消失

- 只能处理小尺寸灰度图像

- 池化方式是平均池化(现代更常用最大池化)