TSception(2022):从EEG中捕捉时间动态和空间不对称性以进行情感识别

1、研究背景和动机

🧠 情绪识别的价值与挑战

- 特征提取困难:传统方法依赖人工设计特征(如功率谱密度、相位锁定值、差分熵),需要大量专业知识,且难以适应数据的非平稳特性。

- 情绪加工的神经机制复杂:大脑在情绪处理过程中存在 多时间尺度的动态变化 和 左右半球的不对称激活,现有模型难以同时高效捕捉这些模式。

🧩 现有方法的不足

- 时间卷积核单一:它们通常只用一个固定长度的时间卷积核,无法捕捉 EEG 中多尺度的时间动态。

- 空间建模不充分:大多数方法只用全局空间卷积核,难以专门针对情绪处理的 左右半球不对称性 进行建模。

🚀 TSception 的提出动机

- 同时捕捉多时间尺度的动态特征

- 通过 多尺度一维时间卷积核 来匹配不同频段的神经活动,既能分析低频(如 α、β 波)又能感知高频动态变化。

- 利用大脑左右半球的情绪不对称性

- 特别设计了 全局卷积核 + 半球卷积核,既能学习全局脑区模式,又能刻画左右半球在情绪加工中的差异。

- 构建轻量化、端到端的情绪识别模型

- 避免繁琐的手工特征工程,减少模型参数量(仅为 DeepConvNet 的约 1/10),以适应 实时脑机接口(BCI) 和在线应用场景。

🌟 一句话总结

TSception 的动机是让模型“像神经科学家一样”看待 EEG —— 不仅要在多个时间尺度上捕捉大脑情绪加工的动态,还要考虑大脑左右半球的功能不对称性,同时做到轻量化和端到端学习,从而超越传统依赖人工特征的情绪识别方法。

2、核心创新点总结

🚀 创新点 1:多时间尺度卷积模块(Temporal Sception)

- 问题背景: DeepConvNet、EEGNet 等方法只使用单一卷积核长度,难以同时捕捉 EEG 中 低频慢变化(如 α/β 波) 和 高频快速动态(如 γ 波、ERP 细节)。

- TSception 的做法:

- 设计 多尺度时间卷积核,每个核长度不同(短核捕捉快速瞬时变化,长核捕捉缓慢趋势)。

- 类似 Inception 的思想:并行提取多种时间粒度特征,再将结果拼接。

- 意义: 模型能更全面地描述情绪加工的时间动态,提高对不同频段神经信号的敏感性。

🧩 类比:就像用多种不同焦距的相机镜头同时拍摄,既能看清整体趋势,也能放大关键细节。

🚀 创新点 2:左右半球分块空间卷积(Spatial Sception)

- 问题背景: 大脑在情绪处理上有明显 左右半球功能不对称(右半球对负性情绪敏感,左半球与积极情绪相关),但以往 CNN 多用统一的全局空间卷积,无法体现这种生理结构。

- TSception 的做法:

- 空间卷积分为 三类卷积核:

- 全局核:覆盖所有电极,提取整体脑网络模式。

- 左半球核:只关注左侧电极。

- 右半球核:只关注右侧电极。

- 最后将三路结果拼接,融合全局与半球信息。

- 空间卷积分为 三类卷积核:

- 意义: 模型能自动学习与情绪加工相关的 半球差异性激活模式,符合神经科学发现,提升分类解释性与性能。

🧩 类比:就像分析比赛录像时,既要看全场整体战术,还要分别观察左右两翼的发挥。

🚀 创新点 3:端到端轻量化设计

- 问题背景: DeepConvNet 参数量大、训练慢;ShallowConvNet 简单但表达力不足;EEGNet 虽轻量但对情绪时空特征建模有限。

- TSception 的做法:

- 使用 一维卷积核 和 分组空间卷积,大幅减少参数量。

- 网络深度适中(相比 DeepConvNet 仅约 1/10 的参数),支持实时 BCI。

- 保持全端到端,不需要复杂的人工特征工程。

- 意义: 既能在小数据集上训练,也适合实时情绪识别与可穿戴设备部署。

🧩 类比:从“重型单反相机”变成“轻便微单”,同时保持画质不打折。

🚀 创新点 4:同时兼顾性能与可解释性

- 问题背景: CNN 虽然有效,但常被批评为“黑箱”;DeepConvNet 虽有简单可视化,但难解释深层决策。

- TSception 的做法:

- 通过 半球卷积核设计,天然与神经生理结构对齐;

- 可结合可视化方法(如 Grad-CAM)解释哪些时间段和脑区对情绪分类贡献最大。

- 在 SEED、SEED-IV 等情绪数据集上达到高准确率同时保持解释友好。

- 意义: 提高深度模型在情绪脑机接口领域的信任度,为神经科学研究提供参考。

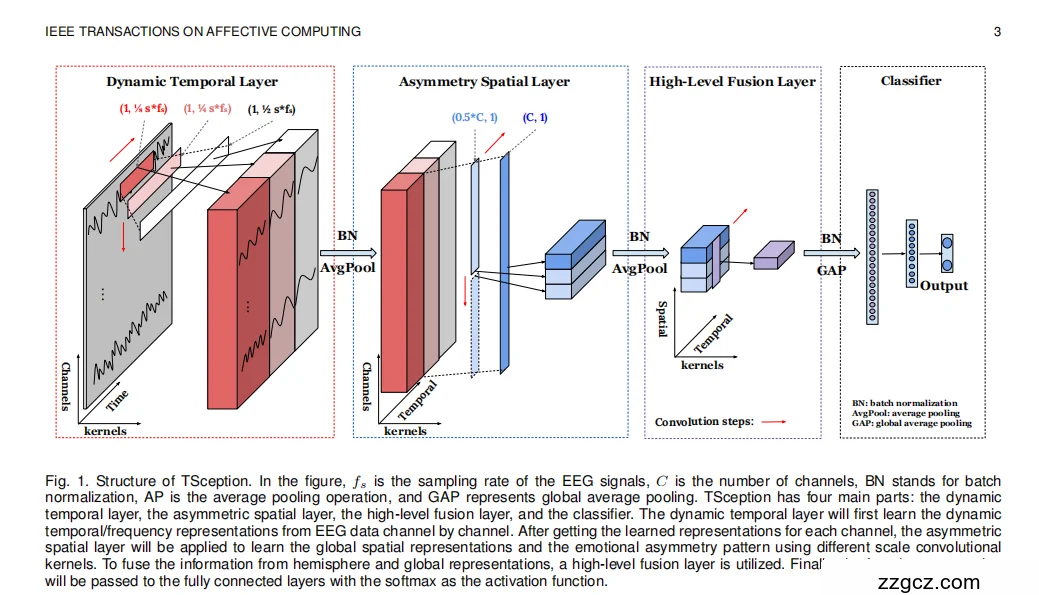

3、模型的网络结构

🧩 TSception 网络结构总览

- Dynamic Temporal Layer(动态时间层)

- Asymmetry Spatial Layer(左右半球不对称空间层)

- High-Level Fusion Layer(高层特征融合层)

- Classifier(分类器)

先用多尺度卷积提取 EEG 时间动态 → 再用左右半球 + 全局卷积捕捉空间特征 → 然后高层融合时间和空间信息 → 最后输出情绪类别。

1️⃣ Dynamic Temporal Layer —— 多时间尺度动态特征提取

- 作用:从每个 EEG 通道的时间序列中,提取不同节律的动态信息。

- 做法:

- 使用 多组一维时间卷积核,每组卷积核长度不同(图中

(1, ¼ s f_s)、(1, ½ s f_s)表示按采样率取不同长度的卷积窗口)。 - 短卷积核提取快速变化(高频成分),长卷积核提取慢速节律(如 α、β 波)。

- 每个卷积后接 Batch Normalization (BN) 和 平均池化 (AvgPool),保证特征稳定。

- 使用 多组一维时间卷积核,每组卷积核长度不同(图中

🔍 理解:这一层就像给每个通道配备了多种“时间放大镜”,同时观察不同频率的波动。

2️⃣ Asymmetry Spatial Layer —— 左右半球+全局空间建模

- 作用:学习大脑空间分布模式,尤其是左右半球的情绪不对称性。

- 做法:

- 将 EEG 通道按左右半球分组:

- 半球卷积核(图中 0.5×C 表示左半球或右半球一半通道)。

- 全局卷积核(C 表示所有通道)。

- 对每种分组应用一维卷积(方向沿通道轴),学习空间加权组合。

- BN 正则化后,输出 左半球特征 / 右半球特征 / 全局特征 三路结果。

- 将 EEG 通道按左右半球分组:

🔍 理解:这一层相当于三个“观察视角”:看全脑整体,再分别聚焦左右脑,提取与情绪相关的非对称激活模式。

3️⃣ High-Level Fusion Layer —— 高层特征融合

- 作用:将前两层学到的时间特征和空间特征进行高效融合。

- 做法:

- 首先分别对时间和空间特征进行卷积和池化,降低维度、提炼关键信息。

- 然后将多路特征拼接成统一表示,再经过 Batch Normalization (BN) 和 全局平均池化 (GAP) 得到紧凑的高层特征向量。

🔍 理解:这一层像是“信息汇总台”,把多时间尺度 + 左右半球 + 全局空间的特征统一起来,形成最终高层表达。

4️⃣ Classifier —— 分类器

- 作用:将融合后的高维特征映射到情绪标签。

- 做法:

- 使用一个全连接层(Dense)加 Softmax 输出,预测情绪类别(如高兴、平静、悲伤等)。

- 因为前面特征已经高度抽象,这里只需要一个简单的线性分类头。

🔍 理解:最后一步像“投票机”,用汇总的时空信息来判断情绪类别。

🔬 数据流总结

- 输入:原始多通道 EEG 时序信号

- 动态时间层:多尺度时间卷积 → 平均池化 → 提取每通道的多频率动态特征

- 空间不对称层:对每个通道特征进行左右半球/全局卷积 → 提取空间模式

- 高层融合层:整合时间 + 空间特征 → BN + GAP 压缩

- 分类器:全连接 + Softmax 输出情绪标签

4、模型的核心不足与局限

- 对跨被试泛化能力有限

- 原因: TSception 虽然引入了左右半球分块和多时间尺度建模,但训练时依旧高度依赖单个被试的数据分布。不同被试的 EEG 信号在电极位置、头皮导电性、个体神经差异上存在较大变化,这导致模型在跨被试迁移时性能显著下降。

- 影响: 每次换被试时需要重新微调或重新训练,限制了实际应用中的通用性和部署效率。

⚠️ 类比:像是为某个歌手定制的声卡调音,换个人使用时音效就变差。

- 空间信息建模仍相对简化

- 原因:

TSception 的空间层虽然考虑了左右半球差异,但整体上还是 1D 卷积 沿通道方向,主要是“左右划分 + 全局”三种模式。

- 它没有显式建模脑区间的复杂拓扑关系(如电极之间的连接强度或功能网络)。

- 大脑并非严格左右对称,情绪加工也涉及额叶、边缘系统等更复杂区域。

- 影响: 对复杂脑区交互模式、动态功能连接的表征能力有限,可能导致模型在高难度情绪任务或脑区差异显著的数据上性能不足。

⚠️ 类比:就像地图只分东西两块区域,但没画出区域内的道路和城市连接。

- 时间依赖仍然是局部建模

- 原因:

TSception 的多时间尺度卷积虽然能捕捉不同频率的局部模式,但本质上仍是卷积局部感受野:

- 无法像 Transformer 或 TCN 那样建立真正的长时序依赖;

- 对持续数秒甚至十几秒的认知或情绪状态变化建模不够充分。

- 影响: 在需要长时间上下文(如慢性情绪变化、持续注意力波动)的任务中表现受限。

⚠️ 类比:像是用不同长度的“窗户”观察视频,但依旧无法看到整部影片的全局剧情。

- 对噪声和伪影的鲁棒性不够强

- 原因:

EEG 容易受到眼动、肌电、运动伪影等影响,TSception 没有内置专门的抗噪机制(如注意力选择、对抗训练或自适应滤波)。

- 它主要依赖训练数据和 BN 来缓解噪声,但在现实场景中(如佩戴式 EEG,信号质量差)可能性能下降。

- 影响: 需要依赖较干净的预处理数据,对实时、低成本 EEG 系统适应性不足。

⚠️ 类比:需要“安静环境”才能听歌,一旦背景噪声多就分辨不清旋律。

- 可解释性仍有提升空间

- 原因:

TSception 虽然结构上与神经科学知识对齐(如半球卷积),但对深层特征的解释仍然依赖外部可视化工具(Grad-CAM、LRP)。

- 模型内部没有原生的可解释模块;

- 对非神经科学背景的人仍然难以理解其高层特征意义。

- 影响: 在临床和医疗领域应用时,医生和研究人员可能仍对模型决策缺乏充分信任。

- 实时部署与效率的平衡仍有限

- 原因:

虽然 TSception 已比 DeepConvNet 小,但在资源受限设备(如低功耗可穿戴 BCI)上推理仍然不够轻量化。

- 网络没有使用量化、剪枝等进一步优化;

- 对极低延迟实时反馈场景支持有限。

- 影响: 在移动端或实时情绪监测上仍需要工程优化或硬件支持。

5、未来改进方向

1️⃣ 提升跨被试泛化与迁移能力

局限

改进方向

- 领域自适应 (Domain Adaptation)

- 利用分布对齐(如最大均值差异 MMD)、对抗学习减少不同被试分布差异。

- 迁移学习与元学习

- 大规模 EEG 数据预训练,再少量微调即可适应新用户。

- 元学习(MAML、Reptile)帮助快速适应新被试。

- 图神经网络 (GNN) 提升跨被试鲁棒性

- DAGCN 通过动态注意力图卷积显式建模脑区连接,能在不同头型、电极布局下适应性更强。

🧩 趋势:未来 EEG 模型需要像 NLP 中的预训练大模型一样,具备快速迁移到不同人群的能力。

2️⃣ 空间信息更丰富的拓扑建模

局限

改进方向

- 基于脑电图谱的图卷积网络 (GCN)

- 根据电极间几何距离或功能连接构建脑区图,再用 动态图注意力 (Dynamic Graph Attention) 学习通道关系。

- DAGCN 就在 TSception 基础上进一步刻画脑区拓扑关系。

- 混合空间建模

- 结合全局卷积与局部图卷积,既捕捉全脑模式也关注局部交互。

🧩 趋势:未来 EEG 模型会从“左右半球”升级为“动态脑网络图”,精细地描述不同脑区之间的信息流。

3️⃣ 更强的时间序列建模与长时依赖

局限

改进方向

- 时间卷积网络 (TCN)

- EEG-TCNet 在卷积后加入 TCN,通过扩张卷积实现长时间上下文建模。

- Transformer 架构

- EEG-Transformer 用自注意力捕捉任意时间点之间的依赖关系,比卷积更适合长时 EEG 序列。

- 混合结构

- CNN 提取局部特征 + Transformer 建模全局依赖,兼顾效率和表达力。

🧩 趋势:未来模型会将 局部卷积 + 全局注意力 结合,使其既能抓住细节又能理解长时情绪动态。

4️⃣ 提高对噪声与伪影的鲁棒性

局限

改进方向

- 注意力机制过滤噪声

- 动态选择信息丰富的通道与时间段,弱化伪影干扰(DAGCN 已有探索)。

- 对抗训练与数据增强

- 用含噪数据增强训练,提高模型容错性。

- 自适应滤波模块

- 将信号去噪与特征提取结合在同一网络中(例如结合时频滤波层)。

🧩 趋势:模型将能自动适应信号质量波动,减少对复杂预处理的依赖。

5️⃣ 加强可解释性与神经科学关联

局限

改进方向

- 集成 XAI 方法

- 在网络中原生集成 Grad-CAM、LRP 等解释模块。

- 生理先验约束

- 在损失函数或结构中显式引入神经解剖学、功能连接等知识。

- 脑区可视化与反馈

- 提供更直观的时空热图,帮助科研和临床用户理解模型决策。

🧩 趋势:未来 EEG 模型将不仅预测情绪,还能回答“为什么做出这个判断”,并对应到具体脑区和时间段。

6️⃣ 轻量化与实时部署优化

局限

改进方向

- 模型压缩与剪枝

- 减少冗余通道与卷积核,保持性能的同时大幅降低计算量。

- 量化与蒸馏

- 用低比特表示参数或用大模型蒸馏小模型。

- NAS 自动搜索

- 自动找到在特定硬件(如嵌入式 EEG 设备)上最优的高效结构。

🧩 趋势:未来 EEG 情绪识别模型会像移动端图像模型一样,具备轻量化和低功耗特性,适合可穿戴设备和实时 BCI。

🏆 改进方向与代表模型对照表

局限点

| 改进方向

| 代表模型

|

跨被试泛化差

| 领域自适应、迁移学习、元学习

| DAGCN

|

空间建模简单

| 脑图+GCN、动态注意力图

| DAGCN

|

长时依赖不足

| TCN、Transformer、混合架构

| EEG-TCNet, EEG-Transformer

|

噪声敏感

| 注意力抗噪、自适应滤波、对抗训练

| DAGCN、TSception 改进版

|

可解释性不足

| XAI 集成、神经先验

| 解释型 EEG-Transformer、可视化增强模型

|

实时部署困难

| 压缩、剪枝、量化、NAS

| 轻量化 EEGNet++、Tiny-Transformer

|