A010-基于ResNet50模型的船型识别与分类系统研究

【购买前必看】

1、关于我们

深度学习乐园是由python哥全职技术团队组建运营【团队成员为:复旦大学博士、华东理工爱丁堡博士、格拉斯哥博士、纽约大学硕士、浙江大学硕士】。

我们只做python业务,精通sklearn机器学习/torch深度学习/django/flask/vue全栈开发。

2、关于项目

我们从2018年开始,就专注于深度学习sci、ei、ccf、kaggle等,至今已有7年,共发表过10多篇顶刊顶会。

官网累积了数百个项目,已有3000多学员付费购买,圈子内有口皆碑:www.zzgcz.com (更多高级私密项目无法对外,联系微信定制:zzgcz_com)

3、售后承诺

包远程安装调试,所有项目均在本地运行通过,大部分都有截图和录屏。

支持二次修改,所有项目都是我们自己写的,改起来也非常容易。

加急定制1-2天可完成,这就是实力证明,远程验收满意后再付全款!

所有客户终身售后。兼职的人家都有主业,谁愿意持续服务你?

项目包截图:

1. 项目简介

本项目旨在实现基于深度学习的船型识别系统,主要针对不同类型船只的图像进行自动分类。该项目的背景是随着海洋监控、海事安全和船只管理需求的不断增长,快速准确地识别海上船只的类型成为一项重要的技术挑战。传统的船只识别方法主要依赖人工特征提取和规则匹配,但由于海上环境复杂多变,如光照、船体角度、海况等因素影响,这种方法的表现较为有限。因此,本项目采用深度学习模型,充分利用卷积神经网络(CNN)的强大特征提取能力,通过学习大规模的船只图像数据集来提升识别精度。

项目中选用的模型是基于经典的ResNet-50结构,并结合迁移学习策略来提高模型的收敛速度和泛化能力。具体应用场景包括:海上交通管控、海事安全预警、无人机巡航系统等。通过对输入图像的自动分类,本项目能够识别如货船、渔船、帆船、军舰等多种常见船型,为海洋管理提供准确、可靠的技术支持。最终目标是开发一个能够高效处理和识别多种船型的系统,并通过不断优化模型性能来满足实际应用需求。

2.作业要求

本次作业的目标是让您熟悉使用 PyTorch 框架构建和训练深度学习模型的过程。您将使用预训练的 ResNet50 模型,对船型图片数据集进行分类。通过完成本作业,您将掌握以下内容:

-

数据集的加载与预处理

-

使用 PyTorch 定义和训练深度学习模型

-

训练过程的可视化

-

模型的评估与保存

任务一:数据集加载与预处理

-

实现一个函数

load_datasets,用于加载和预处理数据集,增加参数is_test,默认值为True。 -

当

is_test=True时,从每个类别中随机选取固定数量的图片(例如,50 张)用于训练和验证。 -

将选取的图片按照指定的验证集比例(例如,20%)划分为训练集和验证集。

任务二:模型定义与训练

-

使用

torchvision.models加载预训练的 ResNet50 模型,并修改全连接层以匹配数据集的类别数量。 -

实现训练函数

train_model,包括训练过程、验证过程和模型保存。 -

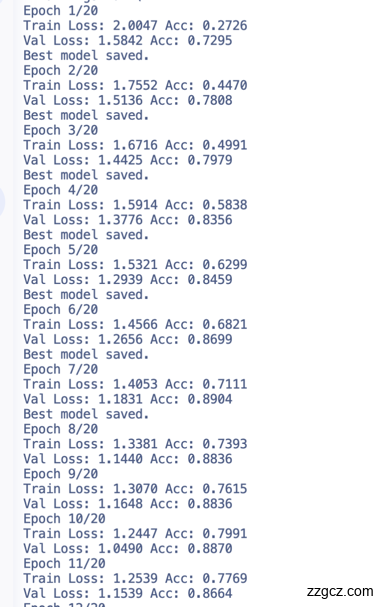

在训练过程中,记录每个 epoch 的训练和验证损失、准确率。

任务三:结果分析与可视化

-

实现函数

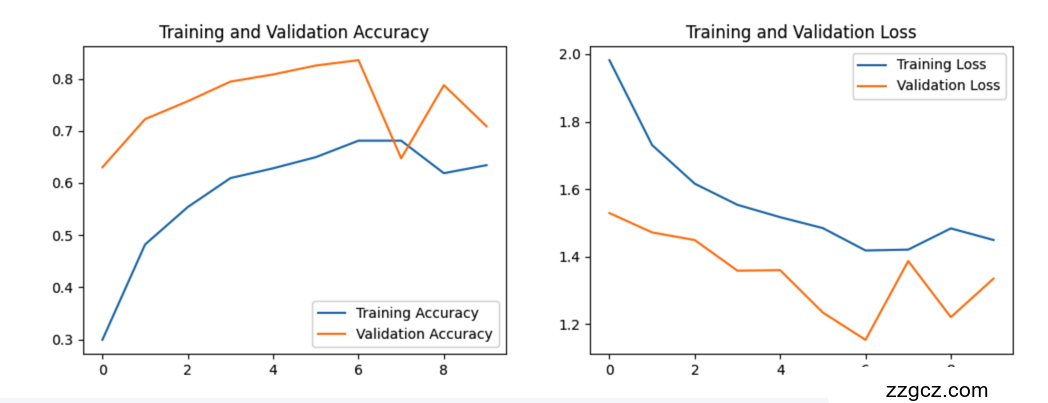

plot_training_history,绘制训练和验证的损失曲线、准确率曲线。 -

实现函数

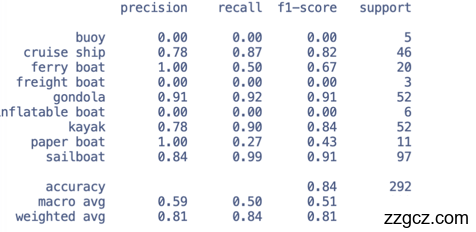

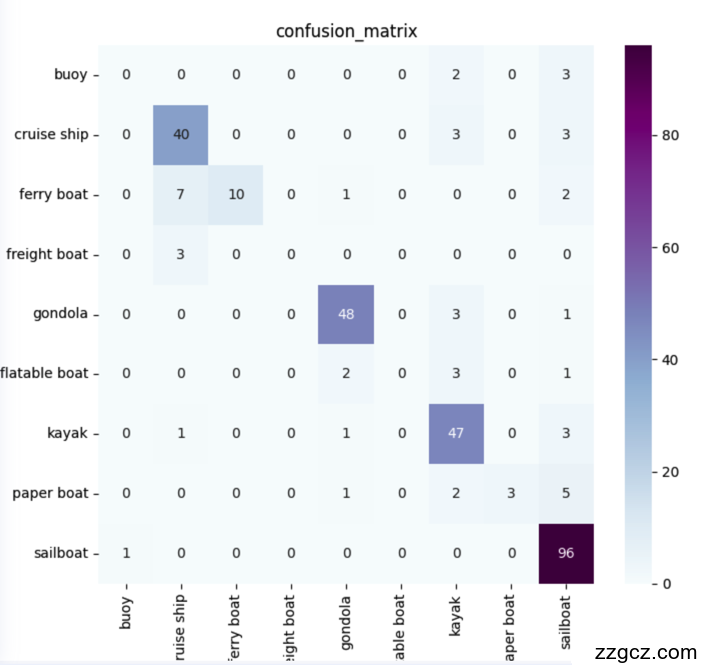

generate_report,在验证集上生成分类报告和绘制混淆矩阵。 -

分析模型的性能,讨论可能的改进方向。

任务四:模型保存与加载

-

在训练过程中,保存验证准确率最高的模型权重到文件

best_model.pth。 -

训练结束后,保存最终的模型权重到文件

final_model.pth。 -

提供加载模型权重的代码示例,说明如何在后续使用中加载和评估模型

3. 结果展示:

- 使用了预训练权重,已经具备较强的特征提取能力。这意味着,即使全连接层(分类器)未经过训练,模型依然能够提取有意义的特征,从而在验证集上可能表现出较高的准确率。

4. 模型架构

1. 模型结构逻辑与数学公式

本项目基于ResNet-50结构进行船型识别任务,并在预训练的ResNet-50模型基础上进行修改,添加了自定义的全连接层以实现特定的分类任务。模型的每一层逻辑和功能如下:

第一个线性层(全连接层):

-

功能:将ResNet50输出的高维特征(例如2048维)映射到较低的维度(512维)。

-

优点:通过减少特征维度,模型能够更高效地处理数据,同时保留关键信息。这有助于减少计算资源的消耗,并可能提升模型的泛化能力。

激活函数(ReLU):

-

功能:应用ReLU(线性整流单元)激活函数,引入非线性。

-

优点:非线性激活函数使模型能够学习和表示更复杂的模式和特征,提升模型的表达能力。

Dropout层:

-

功能:随机丢弃50%的神经元,防止过拟合。

-

优点:通过随机屏蔽部分神经元,Dropout层有助于防止模型对训练数据的过度拟合,提高模型在未见过数据上的泛化性能。

批归一化层(Batch Normalization):

-

功能:对512维的特征进行归一化处理。

-

优点:批归一化加速了训练过程,稳定了模型的学习过程,减少了对初始权重的敏感性,从而提高了模型的收敛速度和稳定性。

第二个线性层:

-

功能:将特征维度从512进一步减少到16。

-

优点:逐步降维的设计能够更细致地提取和压缩特征,进一步提升模型的表达能力,并减少参数数量,降低计算复杂度。

再次应用激活函数(ReLU):

-

功能:在第二个线性层之后再次应用ReLU激活函数。

-

优点:继续引入非线性,增强模型的表达能力,使其能够捕捉更复杂的特征关系。

再次添加Dropout层:

-

功能:再次丢弃50%的神经元,继续防止过拟合。

-

优点:进一步增强正则化效果,提高模型的泛化能力。

再次添加批归一化层:

-

功能:对16维的特征进行归一化。

-

优点:进一步稳定模型的训练过程,提高训练效率,确保模型在不同训练批次间保持一致的分布。

最终线性层:

-

功能:将16维的特征映射到最终的类别数量

num_classes。 -

优点:这一层的输出对应于每个类别的得分或概率,用于最终的分类决策。通过映射到具体的类别数,模型能够根据任务需求灵活调整输出维度。

5. 核心代码详细讲解

在深度学习项目中,数据加载和预处理是至关重要的步骤。PyTorch 提供了强大的数据处理工具,其中 torch.utils.data.Dataset 是一个抽象类,用户可以通过继承它来自定义数据集。下面,我们将深入讲解你提供的 CustomDataset 类,理解其每个部分的功能和实现细节。

完整代码片段

-

Dataset类简介: -

Dataset是 PyTorch 提供的一个抽象类,定义了数据集的基本接口。 -

任何继承自

Dataset的子类都需要实现三个基本方法:__init__、__len__和__getitem__。 -

为什么需要自定义数据集:

-

默认的数据集类(如

torchvision.datasets中的类)适用于常见的数据集格式。 -

对于特定任务或自定义数据存储方式,用户需要通过继承

Dataset类来创建适合自己需求的数据集类。 -

初始化方法

init -

方法签名:

-

__init__是类的构造函数,用于初始化类的实例。 -

参数解释:

-

image_paths:一个列表,包含所有图像文件的路径。每个元素是一个字符串,指向一张图片的位置。 -

labels:一个列表,包含每张图像对应的标签。通常是整数或类别名称的索引。 -

transform:可选参数,用于对图像进行预处理的转换操作。通常使用torchvision.transforms定义的数据增强或标准化操作。 -

成员变量:

-

self.image_paths:存储图像路径列表,供后续访问。 -

self.labels:存储标签列表,与图像路径一一对应。 -

self.transform:存储转换方法,在获取图像时应用于图像数据。

示例:

假设有以下图像路径和标签:

初始化 CustomDataset:

dataset = CustomDataset(image_paths, labels, transform=your_transforms)

-

方法

len -

功能:

-

返回数据集的大小,即图像的总数量。

-

重要性:

-

让 PyTorch 知道数据集有多少样本,以便在训练过程中进行迭代。

-

实现细节:

-

使用内置的

len函数获取self.image_paths列表的长度。

示例:

-

方法

getitem -

功能:

-

根据给定的索引

idx,返回对应的图像及其标签。 -

参数解释:

-

idx:整数,表示要获取的数据样本的索引。 -

与

DataLoader的集成

CustomDataset 通常与 torch.utils.data.DataLoader 一起使用,以便高效地批量加载数据。

示例:

-

参数解释:

-

batch_size:每个批次加载的样本数量,这里设置为16。 -

shuffle:是否在每个 epoch 开始时打乱数据顺序,这有助于提高模型的泛化能力。 -

num_workers:加载数据的子进程数量,增加可以加快数据加载速度,特别是在 I/O 密集型任务中。

6. 模型改进:类别不均衡

-

数据重采样(Resampling):

-

过采样(Oversampling)少数类:

-

随机过采样(Random Oversampling): 从少数类中随机复制样本,增加少数类的样本数量。

-

SMOTE(Synthetic Minority Over-sampling Technique): 通过插值生成新的少数类样本,而不是简单地复制。

-

ADASYN(Adaptive Synthetic Sampling): 基于 SMOTE 的改进,更多地合成难以学习的少数类样本。

-

欠采样(Undersampling)多数类:

-

随机欠采样(Random Undersampling): 从多数类中随机删除样本,减少多数类的样本数量。

-

集成欠采样(Ensemble Undersampling): 结合多个欠采样子集,构建更稳定的模型。

-

调整模型权重(Class Weights):

-

修改损失函数: 在损失函数中对少数类赋予更高的权重,使模型在训练时更加关注少数类。

-

PyTorch 示例:

-

自动计算权重: 使用 sklearn 的

compute_class_weight函数。