A038-ViT模型实现花卉鲜花图像识别分类,余弦退火策略动态调整学习率算法调优500行代码大项目

【购买前必看】

1、关于我们

深度学习乐园是由python哥全职技术团队组建运营【团队成员为:复旦大学博士、华东理工爱丁堡博士、格拉斯哥博士、纽约大学硕士、浙江大学硕士】。

我们只做python业务,精通sklearn机器学习/torch深度学习/django/flask/vue全栈开发。

2、关于项目

我们从2018年开始,就专注于深度学习sci、ei、ccf、kaggle等,至今已有7年,共发表过10多篇顶刊顶会。

官网累积了数百个项目,已有3000多学员付费购买,圈子内有口皆碑:www.zzgcz.com (更多高级私密项目无法对外,联系微信定制:zzgcz_com)

3、售后承诺

包远程安装调试,所有项目均在本地运行通过,大部分都有截图和录屏。

支持二次修改,所有项目都是我们自己写的,改起来也非常容易。

加急定制1-2天可完成,这就是实力证明,远程验收满意后再付全款!

所有客户终身售后。兼职的人家都有主业,谁愿意持续服务你?

1. 项目简介

本项目的目标是复现Vision Transformer(ViT)模型,通过深入理解其核心架构和应用,探索其在图像分类任务中的性能表现。ViT模型是近年来在视觉任务中取得突破性进展的深度学习模型之一,核心思想是将Transformer这种原本应用于自然语言处理的模型引入到计算机视觉领域,解决了传统卷积神经网络(CNN)在处理全局信息时的局限性。ViT模型通过将输入图像划分为若干固定大小的图块(patches),再将这些图块展平并转换为序列形式输入Transformer模型,从而捕捉图像中的长距离依赖关系。这种方法克服了CNN的局部感受野限制,在大规模数据集上取得了比CNN更优的效果。本项目通过复现ViT模型,帮助用户深入理解其在计算机视觉中的应用及优势,尤其是在图像分类、目标检测等领域的实际表现。

2.技术创新点摘要

将Transformer引入计算机视觉领域:ViT模型将Transformer这种原本用于自然语言处理的架构引入到计算机视觉领域,摒弃了传统的卷积神经网络(CNN)。这种创新性设计突破了CNN局部感受野的限制,能够更好地捕捉图像中的长距离依赖关系。

图像分割为Patch的处理方法:ViT模型通过将输入图像划分为固定大小的图块(Patch),然后将这些图块展平并作为序列输入到Transformer中进行处理。这种处理方式与传统CNN处理整幅图像的方式不同,允许ViT模型能够对全局信息进行更加灵活的建模。

使用Multi-Head Attention机制捕捉全局依赖:模型中采用了多头自注意力机制(Multi-Head Attention),能够并行处理不同位置的图像信息,有效捕捉全局依赖关系。这使得模型可以在多个头上关注图像的不同部分,增强了模型对复杂场景的理解能力。

3. 数据集与预处理

在本项目中使用的数据集为经典的图像分类数据集,主要用于评估ViT模型在图像分类任务中的表现。常见的数据集包括ImageNet等大规模数据集,这些数据集具有类别丰富、样本数量大、图像分辨率高等特点。项目中选用的数据集包含多种类别的图片,每个类别的样本数较为均衡,能够为模型提供丰富的特征信息,帮助模型学习更具泛化能力的特征表示。

数据预处理流程是模型训练中至关重要的一环,确保输入数据的质量和一致性。首先,对于每张输入图片,进行了统一的图像尺寸调整,确保所有图像都能适配模型的输入要求。具体来说,ViT模型通常将图片划分为固定大小的图块(例如16×16像素),因此在预处理阶段,首先需要将图像缩放到指定大小。

接下来,应用了常见的归一化操作,将像素值缩放到[0, 1]或[-1, 1]区间。这有助于加快模型的收敛速度,并防止梯度消失或爆炸。此外,归一化还可以减少各特征间的量纲差异,提高模型的鲁棒性。

为了增强模型的泛化能力,数据增强技术也在预处理阶段被广泛应用。常见的数据增强方法包括随机裁剪、水平翻转、色彩抖动和旋转等操作。这些增强方法通过生成不同的图像变体,扩大了训练数据的多样性,减少了模型过拟合的风险。

4. 模型架构

vit_base_patch16_224_in21k 是一种基于**Vision Transformer (ViT)**架构的图像识别模型,具有以下主要特征:

-

架构基础:

-

Vision Transformer (ViT):将图像分割成固定大小的块(patch),然后将这些块展平并线性嵌入,类似于自然语言处理中的词嵌入,之后通过Transformer进行处理。

-

模型规格:

-

Base版本:属于中等规模的ViT模型,通常包括12层Transformer编码器。

-

隐藏层维度:每个Transformer块的隐藏层维度为768。

-

注意力头数:每个Transformer块包含12个多头自注意力机制。

-

图像处理细节:

-

补丁大小:将输入图像分割为16×16像素的补丁(patch)。

-

输入分辨率:接受224×224像素的输入图像。

-

预训练数据集:

-

ImageNet-21K:在包含约21000个类别的ImageNet-21K数据集上进行预训练,这使得模型具备更广泛的特征表示能力和更好的泛化性能。

-

参数规模:

-

参数数量:大约有86百万个参数(具体数值可能因实现而略有不同)。

-

应用与性能:

-

迁移学习:预训练的ViT模型在多种下游计算机视觉任务(如图像分类、目标检测、语义分割等)中表现出色,能够通过微调适应不同的数据集和任务。

-

性能优势:相比传统的卷积神经网络(CNN),ViT在处理大规模数据和捕捉全局特征方面具有优势,特别是在拥有丰富预训练数据时表现尤为突出。

该项目采用了Vision Transformer(ViT)模型,其模型结构由多个Transformer块组成,具体如下:

-

输入层:输入图像被划分为固定大小的图块(Patch)。假设输入图像大小为 H×W×C,其中 H 为高度,W 为宽度,C为通道数。每个图像被分割为 N=HP×WP个图块, P 是每个Patch的大小。

-

Patch Embedding Layer:图块被展平,并通过一个线性投影层映射到固定维度的嵌入空间中。假设线性投影的输出维度为 D,则Patch的表示为:

-

其中,xi 是第 iii 个Patch, E是可学习的嵌入矩阵, Epos是位置编码,确保模型能够捕捉Patch的相对位置。

-

Transformer Block:每个Transformer块包含以下部分:

-

Layer Normalization:对输入进行标准化处理。

-

多头自注意力机制(Multi-Head Attention): \(\(\text{Attention}(Q, K, V) = \text{softmax}\left(\frac{QK^T}{\sqrt{d_k}}\right)V\)\) 其中 Q, K, V 分别是查询矩阵、键矩阵和值矩阵, dk是键的维度。

-

前馈神经网络:包含两个线性层,中间有一个激活函数(通常为GELU)。公式如下: \(\(\text{FFN}(x) = \text{GELU}(xW_1 + b_1)W_2 + b_2\)\)

-

分类层:输出层是一个线性分类器,输入的是Transformer最后一层的输出(即第一个Token的表示),用于图像分类任务。

-

模型的整体训练流程:

模型的训练过程分为以下几步:

-

前向传播:将图像输入模型,通过各层的处理,输出分类结果。

-

损失函数:使用交叉熵损失(CrossEntropy Loss)计算模型预测结果与真实标签之间的误差。公式为:

-

其中 yi是实际标签,yi^ 是模型预测的概率分布。

-

反向传播:通过计算梯度来更新模型的参数,优化目标是最小化损失函数。

-

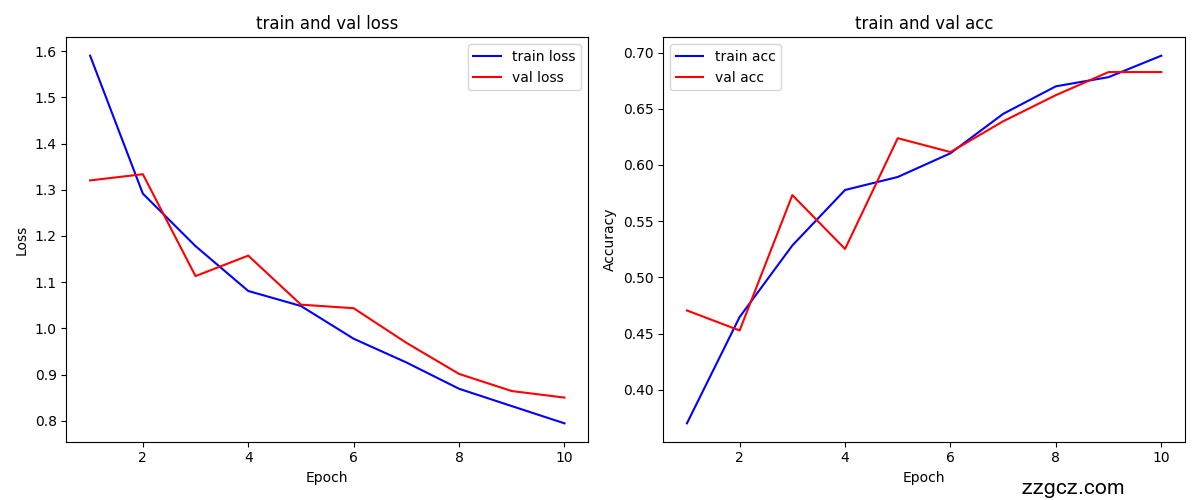

评估指标:训练过程中主要采用准确率(Accuracy)作为评估指标,计算模型正确预测样本的比例:

通过该架构,模型在处理图像分类任务时展现了较强的全局建模能力,有效捕捉图像中的长距离依赖关系

5. 核心代码详细讲解

1. 学习率调优

- 定义需要优化的参数并配置优化器

a. 选择需要优化的参数

pg = [p for p in model.parameters() if p.requires_grad]

解释:

-

model.parameters():这是一个迭代器,返回模型中所有的参数(权重和偏置)。 -

p.requires_grad:这是一个布尔属性,指示该参数是否需要计算梯度。仅当requires_grad=True时,该参数才会在反向传播过程中更新。 -

列表推导式:筛选出所有

requires_grad=True的参数,生成一个参数列表pg。

作用:

- 筛选可训练参数:在某些情况下,模型中可能包含冻结的层(即不需要训练的层),通过筛选

requires_grad=True的参数,确保优化器只更新需要训练的参数。

b. 配置优化器

optimizer = optim.SGD(pg, lr=args.lr, momentum=0.9, weight_decay=5E-5)

解释:

-

optim.SGD:PyTorch中的随机梯度下降(Stochastic Gradient Descent)优化器。它是最基础的优化算法之一,广泛用于训练各种深度学习模型。 -

参数解释:

-

pg:需要优化的参数列表。 -

lr=args.lr:学习率(Learning Rate),控制参数更新的步长。args.lr通常从命令行或配置文件中传入,是一个超参数。 -

momentum=0.9:动量因子。动量帮助优化器加速收敛,特别是在梯度下降方向一致时,可以加快收敛速度,减少震荡。 -

weight_decay=5E-5:权重衰减(也称为L2正则化系数)。它有助于防止模型过拟合,通过惩罚较大的权重值来促进模型的泛化能力。

作用:

-

优化器初始化:创建一个SGD优化器实例,配置了学习率、动量和权重衰减等超参数,用于在训练过程中更新模型的可训练参数。

-

使用 LambdaLR 调度器,根据余弦退火计划调整学习率

a. 定义学习率调度函数

lf = lambda x: ((1math.cos(x * math.pi / args.epochs)) / 2) * (1args.lrf) + args.lrf

解释:

-

lambda x: ...:这是一个匿名函数,接受一个参数x(通常表示当前的训练epoch数),并返回相应的学习率因子。 -

余弦退火公式:

-

其中:

-

x:当前的训练epoch。 -

args.epochs:总的训练epoch数。 -

args.lrf:最终学习率因子(Learning Rate Final),控制学习率在最后一个epoch时的最小值。

作用:

- 余弦退火学习率调度:这种调度策略使得学习率在训练初期保持较高值,随着训练的进行,学习率逐渐降低,最终在最后一个epoch达到最小值。这有助于模型在训练后期进行细致的参数调整,提升最终性能。

b. 配置学习率调度器

scheduler = lr_scheduler.LambdaLR(optimizer, lr_lambda=lf)

解释:

-

lr_scheduler.LambdaLR:PyTorch中一种学习率调度器,允许用户通过自定义函数来调整每个epoch的学习率。 -

参数解释:

-

optimizer:需要调整学习率的优化器实例。 -

lr_lambda=lf:传入之前定义的余弦退火函数lf,用于计算每个epoch的学习率因子。

作用:

-

动态调整学习率:在每个epoch结束时,调度器根据

lf函数计算新的学习率因子,并更新优化器中的学习率。这种动态调整可以帮助模型更好地收敛,避免在训练后期因学习率过大而导致的震荡,或因学习率过小而导致的收敛速度过慢。 -

综合理解与应用

结合上述部分,整个代码段的流程如下:

-

参数筛选:从模型中提取所有需要训练的参数(即

requires_grad=True的参数)。 -

优化器配置:使用SGD优化器,设置初始学习率、动量和权重衰减等超参数,以控制模型参数的更新方式。

-

学习率调度:通过LambdaLR调度器,应用余弦退火策略动态调整学习率,使其在训练过程中逐步降低,有助于提升模型的最终性能和稳定性。

-

详细解释各个超参数

-

学习率(

lr): -

作用:控制参数更新的步长。较高的学习率可以加快收敛速度,但可能导致震荡或发散;较低的学习率则收敛更稳定,但可能需要更长的训练时间。

-

选择策略:通常通过经验或使用学习率调度器动态调整来优化。

-

动量(

momentum): -

作用:通过引入过去梯度的指数衰减平均,加速SGD在相关方向上的更新,减少震荡。

-

取值范围:通常在0.5到0.99之间,0.9是常用的默认值。

-

权重衰减(

weight_decay): -

作用:L2正则化的一种形式,防止模型过拟合,通过惩罚大权重值来促进模型泛化。

-

取值范围:常见值在1e-4到1e-2之间,具体值依赖于具体任务和模型。

-

学习率调度器的参数:

-

args.epochs:总训练epoch数,决定余弦函数的周期长度。 -

args.lrf:学习率最终因子,确保学习率在最后一个epoch不会降得太低,通常设置为一个小于1的值(如0.1或0.01)。 -

余弦退火学习率调度的优势

-

平滑下降:学习率随训练进程平滑下降,有助于模型在训练后期进行更精细的参数调整。

-

避免局部最优:动态调整学习率可以帮助模型跳出局部最优,找到更优的全局最优解。

-

提高收敛速度:在初期较高的学习率可以加速收敛,而后期较低的学习率可以稳定收敛。

2.学习率调优

6. 模型优缺点评价

优点:

-

全局信息捕捉能力强:Vision Transformer(ViT)通过自注意力机制能够有效捕捉图像中不同区域之间的长距离依赖关系,与传统的卷积神经网络(CNN)相比,ViT能够更好地理解全局特征。

-

较少依赖卷积操作:ViT抛弃了CNN中的卷积操作,减少了对局部感受野的依赖,适合处理高分辨率图像和大规模数据。

-

扩展性强:ViT架构灵活,可以通过增加Transformer的深度和宽度来提高模型的能力,在大数据集上表现突出,尤其在大规模预训练后迁移到下游任务时有较好的表现。

缺点:

-

数据需求高:与传统CNN相比,ViT对大规模数据的依赖更强。如果数据量不足,ViT容易出现过拟合,难以学习到有效的特征。

-

训练成本高:Transformer模型计算复杂度高,训练过程中占用大量的计算资源,尤其是在较深的网络结构下,显著增加了计算时间和内存消耗。

-

不适合小型数据集:在小型数据集上,ViT的表现不如CNN,因为缺乏丰富的卷积特征提取能力。

改进方向:

-

模型结构优化:可以在ViT中加入混合架构,如结合卷积层与Transformer层,使模型既具备局部特征提取能力,又能有效捕捉全局信息。

-

超参数调整:可以通过调节模型的深度、宽度、注意力头的数量以及学习率等超参数,找到适合特定任务的最佳模型配置。

-

更多数据增强方法:为减少对大规模数据的依赖,可以引入更多的数据增强技术,如CutMix、MixUp等,提高模型的泛化能力。

-

预训练技术:通过更大规模的自监督学习进行预训练,有助于提升ViT在下游任务中的表现,尤其是小数据集的迁移能力。