A116-SO-BiTCN-BiGRU-Attention多输入单输出回归预测

【购买前必看】

1、关于我们:

我们是全职的技术团队,跟闲鱼上大部分兼职都不一样,所有客户终身售后。兼职的人家都有主业,谁愿意持续服务你?

2、关于业务

我们只做python,尤其擅长sklearn机器学习/torch深度学习/django/flask/vue全栈开发。注意:号称java/c/php啥都会的那100%是骗人的,淘宝上这种虚假宣传特别多!。

3、关于项目:

我们从2018年开始,就专注于毕设、数学建模、会议期刊论文,已有6年,积累了数百个项目,案例官网:www.zzgcz.com。更多私密项目无法展示,联系微信定制:zzgcz_com。

4、关于售后

1)敢承诺100%项目均在本地运行通过,包远程运行安装。

2)所有项目都是我们自己写的,二次修改起来非常容易。

5、关于定制

我们定制开发90%来源于老客户推荐。淘宝上基本被中介垄断了,抽成高达50%以上。他们的模式是:填资料拉群找兼职技术,诱骗你下单,要么技术摆烂最后一天说做不了全退,要么给你一堆烂代码让你退一半,退款率在80%以上。

我们全职定制1-2天可完成,没有中介费!远程验收满意后再付全款

代码说明

-

数据读取与预处理:

-

load_data函数从 CSV 文件读取数据,如果文件不存在则生成并保存。 -

使用

MinMaxScaler对数据进行归一化处理。 -

create_dataset函数根据设定的look_back值创建时间窗口数据集,用于多步预测。 -

模型构建:

-

自定义

AttentionLayer实现注意力机制,用于增强模型对关键时间步的关注。 -

build_model函数构建包含 SO-BiTCN、BiGRU 和 Attention 的深度学习模型。具体结构如下:-

SO-BiTCN:使用多个

Conv1D层模拟 TCN 的特性。 -

BiGRU:使用双向 GRU 层捕捉时间序列的双向依赖关系。

-

Attention:应用自定义的注意力层,以增强模型对重要时间步的关注。

-

最后通过全连接层输出预测结果。

-

-

模型训练与预测:

-

使用

EarlyStopping监控验证损失,防止过拟合。 -

训练过程中记录训练和验证损失,以便后续可视化。

-

训练完成后,对训练集和测试集进行预测,并进行反归一化处理。

-

评估与可视化:

-

evaluate_metrics函数计算均方误差(MSE)、均方根误差(RMSE)和平均绝对误差(MAE)等评估指标。 -

plot_results函数生成以下图表并保存为 PNG 文件:-

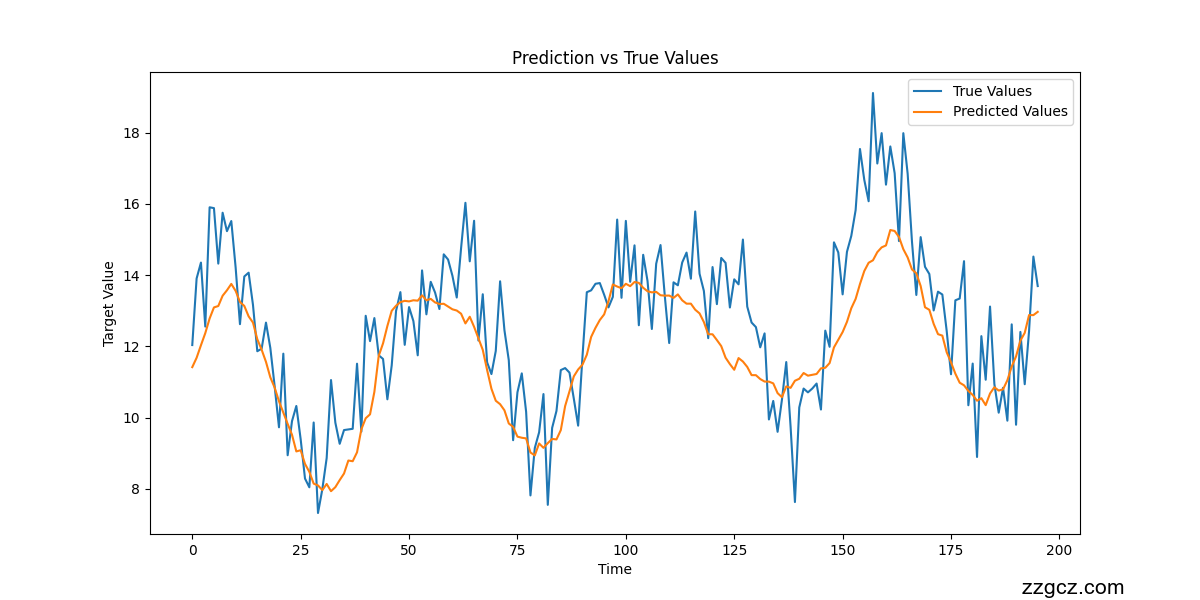

预测效果图:展示真实值与预测值的对比。

-

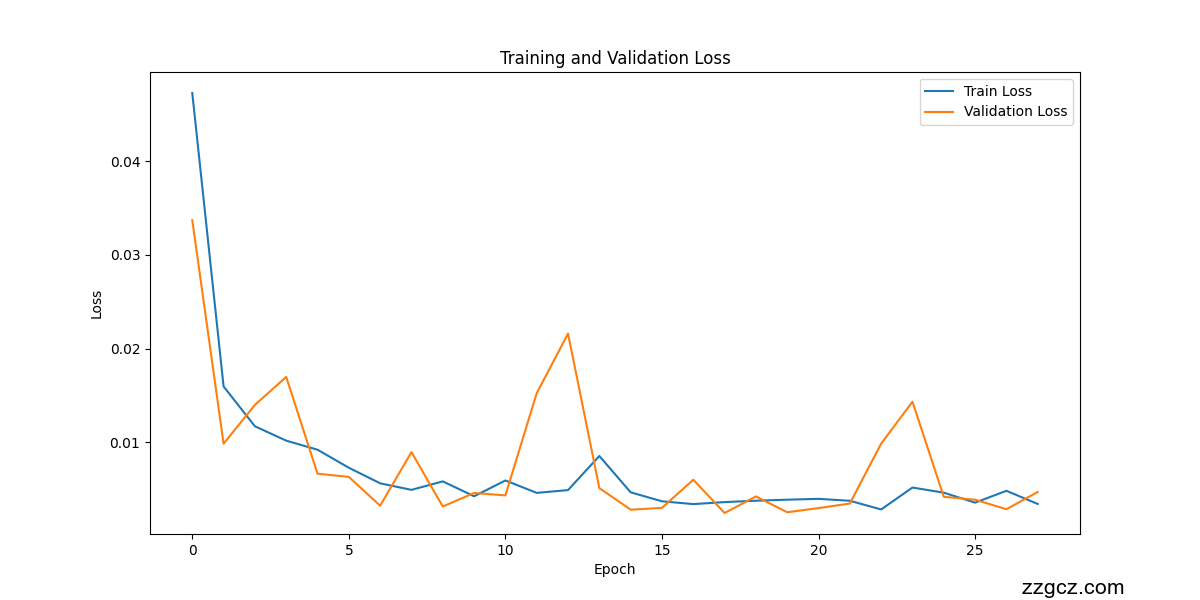

训练过程图:展示训练和验证损失随训练轮次的变化。

-

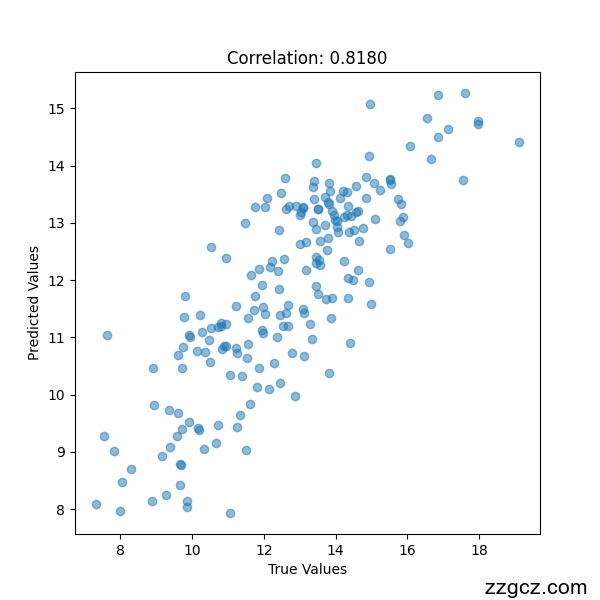

相关分析图:展示预测值与真实值的散点图及其相关系数。

-

运行说明

-

保存代码:将上述代码保存为

so_bitcn_bigru_attention_fixed.py。 -

安装依赖库: 确保安装了必要的Python库:

-

pip install numpy pandas matplotlib scikit-learn tensorflow -

运行代码:在终端或命令行中运行以下命令:

-

python so_bitcn_bigru_attention_fixed.py -

输出结果:

-

数据文件:

multivariate_time_series.csv包含模拟的多变量时间序列数据。 -

评估指标:终端会打印训练集和测试集的 MSE、RMSE 和 MAE。

-

可视化图表:

-

SO-BiTCN-BiGRU-Attention_prediction.png:预测效果图。 -

SO-BiTCN-BiGRU-Attention_training_history.png:训练过程图。 -

SO-BiTCN-BiGRU-Attention_correlation.png:相关分析图。

-