A245-基于BERT+MLP模型的仇恨言论文本分类

【购买前必看】

1、关于我们

深度学习乐园是由python哥全职技术团队组建运营【团队成员为:复旦大学博士、华东理工爱丁堡博士、格拉斯哥博士、纽约大学硕士、浙江大学硕士】。

我们只做python业务,精通sklearn机器学习/torch深度学习/django/flask/vue全栈开发。

2、关于项目

我们从2018年开始,就专注于深度学习sci、ei、ccf、kaggle等,至今已有7年,共发表过10多篇顶刊顶会。

官网累积了数百个项目,已有3000多学员付费购买,圈子内有口皆碑:www.zzgcz.com (更多高级私密项目无法对外,联系微信定制:zzgcz_com)

3、售后承诺

包远程安装调试,所有项目均在本地运行通过,大部分都有截图和录屏。

支持二次修改,所有项目都是我们自己写的,改起来也非常容易。

加急定制1-2天可完成,这就是实力证明,远程验收满意后再付全款!

所有客户终身售后。兼职的人家都有主业,谁愿意持续服务你?

数据说明

包含3个字段:id,文本内容,文本内容对应的类别

具体类别为:是否为仇恨言论

1. 项目概述

本项目旨在构建一个基于BERT嵌入的文本分类模型。通过对原始文本数据进行清洗和预处理,利用BERT提取文本特征,并使用神经网络进行分类任务。模型的性能通过准确率、混淆矩阵以及分类报告进行评估。

2. 数据处理流程

数据读取与检查: 首先,从本地CSV文件中读取数据,仅选取前2000条记录进行处理。读取后,展示前几条数据以检查数据格式和字段信息。

缺失值处理:

统计每一列中的缺失值数量,特别关注Data字段,删除其中包含缺失值的记录,确保数据完整性。

文本清洗:

-

去除文本两端多余的空白字符。

-

合并多余的空格,确保文本格式整洁。

-

删除文本中的特殊字符,仅保留字母、数字以及常用标点符号。

-

过滤掉少于两个单词的短文本,以保证数据的有效性。

重复数据处理:

在清洗完成后,删除Data字段中重复的文本,避免模型训练时受到重复样本的干扰。

3. 特征提取

加载预训练BERT模型: 使用本地预训练的BERT模型和对应的分词器,将文本数据转换为BERT所需的输入格式。

文本编码与嵌入提取:

每条文本数据经过分词处理后,输入到BERT模型中,提取其对应的嵌入向量。使用BERT模型输出中的[CLS]向量,作为每条文本的全局语义表示,便于后续分类任务使用。

4. 模型构建与训练

神经网络模型设计: 构建一个简单的多层感知机(MLP)模型,输入层接收BERT嵌入向量,经过两层隐藏层(分别包含512和256个神经元)和ReLU激活函数,最后输出二分类结果。为防止过拟合,引入Dropout层。

损失函数与优化器: 采用交叉熵损失函数(CrossEntropyLoss)进行多分类任务,优化器使用Adam算法,设置学习率为0.001。

模型训练: 在训练过程中,模型对训练数据进行多轮迭代,优化参数以最小化损失函数。每两轮训练输出一次当前的损失值,便于监控模型的训练状态。

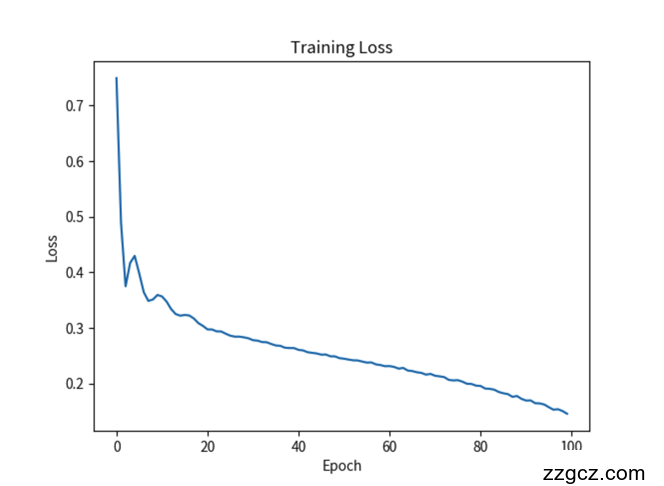

损失曲线可视化: 训练结束后,将每轮的损失值绘制成折线图,以观察模型的收敛情况和学习效果。

5. 模型评估

测试集预测: 将训练好的模型应用于测试集,预测每条文本的分类结果。

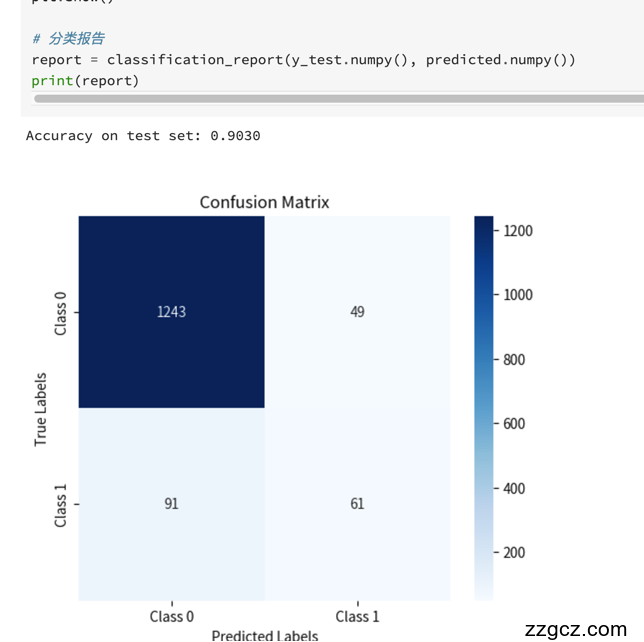

准确率计算: 统计测试集中模型预测正确的样本数量,计算整体准确率,衡量模型性能。

混淆矩阵可视化: 生成混淆矩阵,以热力图的形式展示模型在各类别上的分类效果,便于直观了解模型的分类误差和混淆情况。

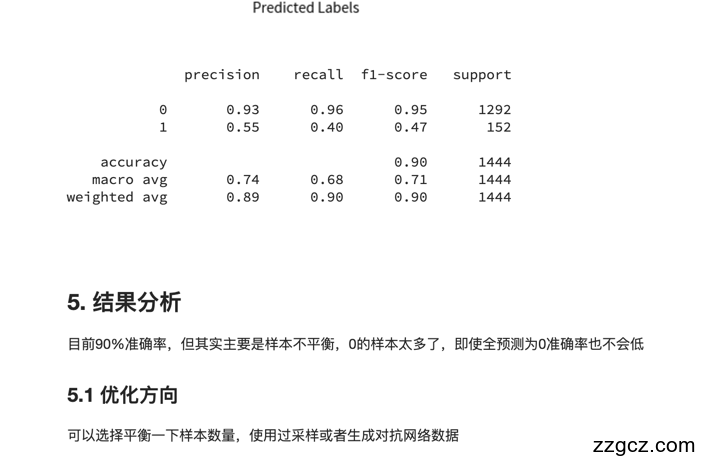

分类报告: 输出分类报告,包括每个类别的精确率(Precision)、召回率(Recall)和F1分数,全面评估模型在不同类别上的表现。

6. 总结

本项目通过BERT模型提取文本特征,结合神经网络进行分类任务,展示了自然语言处理和深度学习的结合应用。经过数据清洗、特征提取、模型训练和评估,最终构建了一个能够有效分类文本数据的模型。模型的性能可以通过调整网络结构、优化参数或进一步清洗数据来改进。