A297-基于cnn和resnet和mobilenet对比实现驾驶员分心检测

【购买前必看】

1、关于我们

深度学习乐园是由python哥全职技术团队组建运营【团队成员为:复旦大学博士、华东理工爱丁堡博士、格拉斯哥博士、纽约大学硕士、浙江大学硕士】。

我们只做python业务,精通sklearn机器学习/torch深度学习/django/flask/vue全栈开发。

2、关于项目

我们从2018年开始,就专注于深度学习sci、ei、ccf、kaggle等,至今已有7年,共发表过10多篇SCI。

官网累积了数百个项目,已有3000多学员付费购买,圈子内有口皆碑:www.zzgcz.com (更多高级私密项目无法对外,联系微信定制:zzgcz_com)

3、售后承诺

包远程安装调试,所有项目均在本地运行通过,大部分都有截图和录屏。

支持二次修改,所有项目都是我们自己写的,改起来也非常容易。

加急定制1-2天可完成,这就是实力证明,远程验收满意后再付全款!

所有客户终身售后。兼职的人家都有主业,谁愿意持续服务你?

本项目旨在通过深度学习技术,结合卷积神经网络(CNN)模型、ResNet模型和MobileNet模型,实现对驾驶员分心行为的自动检测。我们通过训练这些模型来识别不同的驾驶员分心行为,包括如发短信、通话、喝水等行为。使用的数据集包含驾驶员行为的图片,并且针对每个行为标注了相应的标签(例如"正常驾驶"、"右手发短信"等)。

MobileNetV2 是 Google 于 2018 年提出的一种轻量级卷积神经网络架构,专为在移动设备和嵌入式系统上高效部署而设计。其相比传统的深度卷积神经网络(如 ResNet、VGG 等),在保证较高分类准确率的同时,显著减少了模型的参数数量和计算量。

在本课程中,我们选用 MobileNetV2 作为图像分类的基础模型,兼顾了性能、精度与速度,非常适合部署在资源受限的环境中(如智能汽车终端、边缘设备等)。

🧠 二、关键技术点

1. 深度可分离卷积(Depthwise Separable Convolution)

MobileNetV2 的核心构建模块基于深度可分离卷积,它将标准卷积操作拆分为:

-

Depthwise 卷积:对每个通道独立进行空间卷积;

-

Pointwise 卷积:使用 1×1 卷积对通道进行线性组合。

这种分离大大减少了运算量,提升了运行效率。

2. 线性瓶颈结构(Linear Bottleneck)

传统的网络在通过 ReLU 激活函数后会引入信息丢失,而 MobileNetV2 引入了线性瓶颈层,在某些层不使用 ReLU,从而避免特征表达的退化。

3. 倒残差结构(Inverted Residuals)

与 ResNet 的“先压缩后扩展”不同,MobileNetV2 采用“先扩展后压缩”的倒残差结构,有利于保持特征信息,提升建模能力。

📊 模型对比分析:MobileNetV2 vs ResNet vs EfficientNet

项目结构

该项目包含多个部分,包括数据预处理、模型训练、评估以及单张图片预测。我们使用了三个不同的深度学习模型(CNN、ResNet、MobileNet)进行比较,以下是针对项目中每个部分的详细说明。

代码结构说明

- 数据集准备

首先,我们通过自定义的DriverDistractionDataset类加载并处理数据集。该类通过读取CSV文件获取每个图像的路径,并检查图像是否存在。如果图像存在,则保存其路径和标签,确保数据集的完整性。

关于数据:

dict_list_zh = {

'c0': '正常驾驶',

"c1": '右手发短信',

"c2": '右手通话',

"c3": '左手发短信',

"c4": '左手通话',

"c5": '操作收音机',

"c6": '喝水',

"c7": '回头',

"c8": '整理头发',

"c9": '与乘客交谈'

}

- 数据增强与预处理

为了提高模型的鲁棒性,我们对输入数据进行了适当的预处理。使用torchvision.transforms模块进行图像尺寸调整、标准化以及转换为Tensor格式。标准化是根据ImageNet的均值和标准差进行的。

- 模型选择与加载

本项目使用了三个不同的模型进行对比:

-

CNN:标准的卷积神经网络。

-

ResNet:采用残差连接的深度网络。

-

MobileNet:高效的轻量化网络。

每次运行代码时,只需选择一个模型,并进行训练。以下是使用MobileNetV2模型的代码片段,其他模型更换时,只需修改模型名称即可。

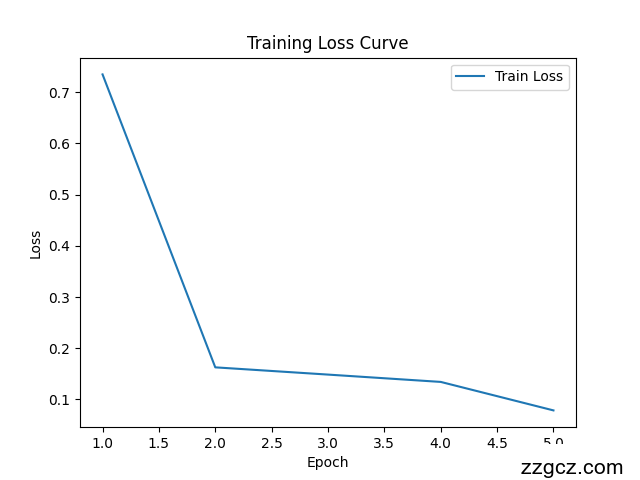

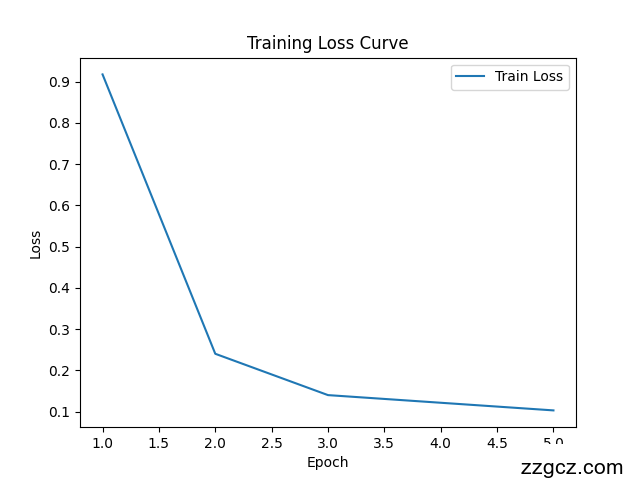

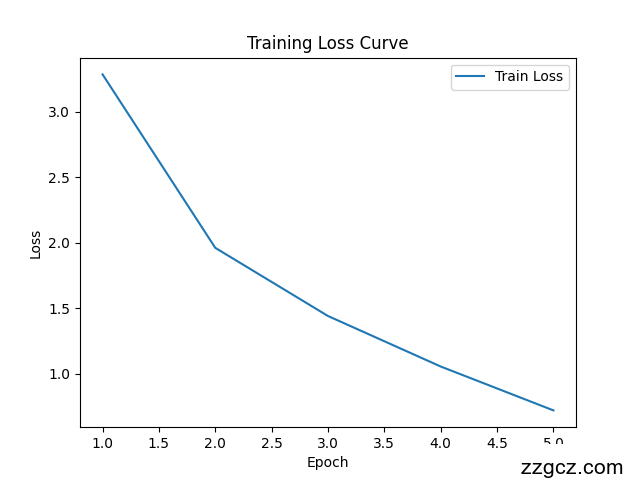

- 模型训练

训练过程使用了标准的交叉熵损失函数(CrossEntropyLoss)和Adam优化器。每个epoch会输出当前的损失值,并绘制训练过程中的损失曲线。

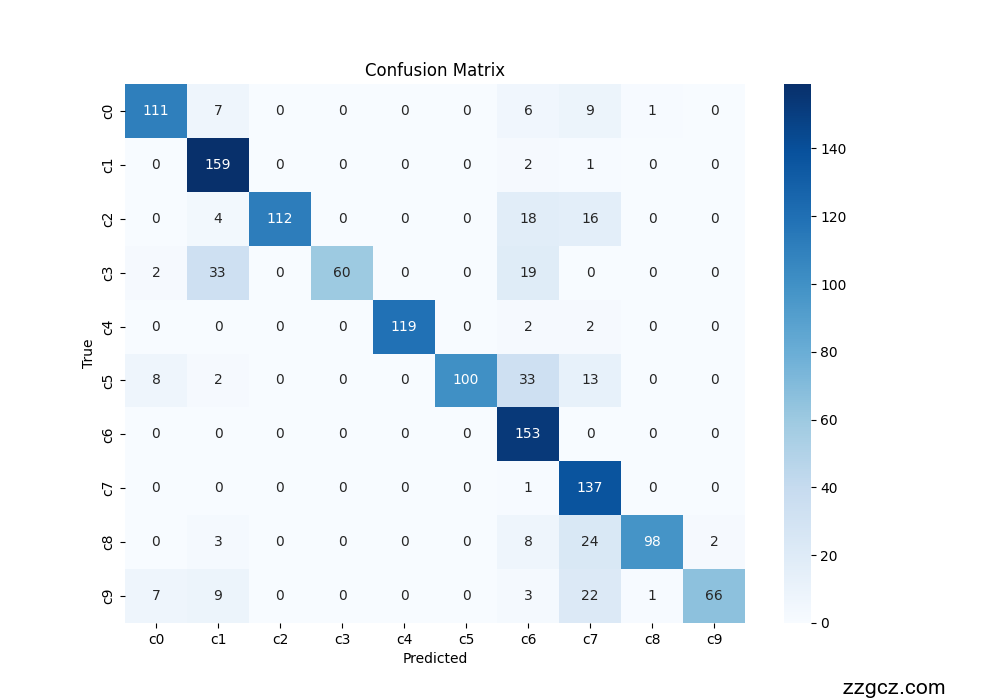

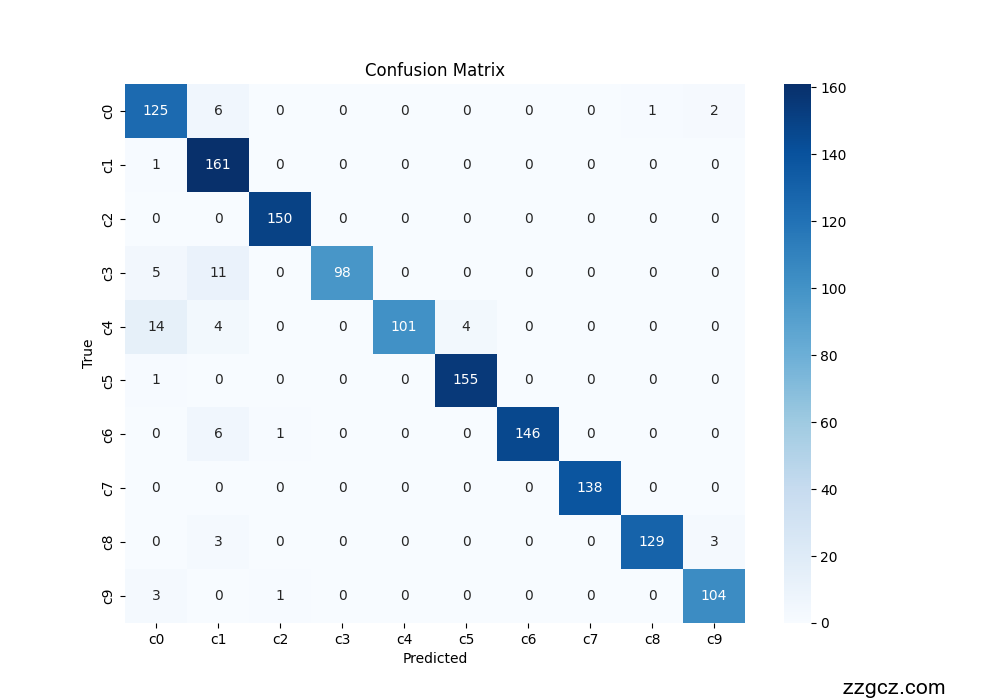

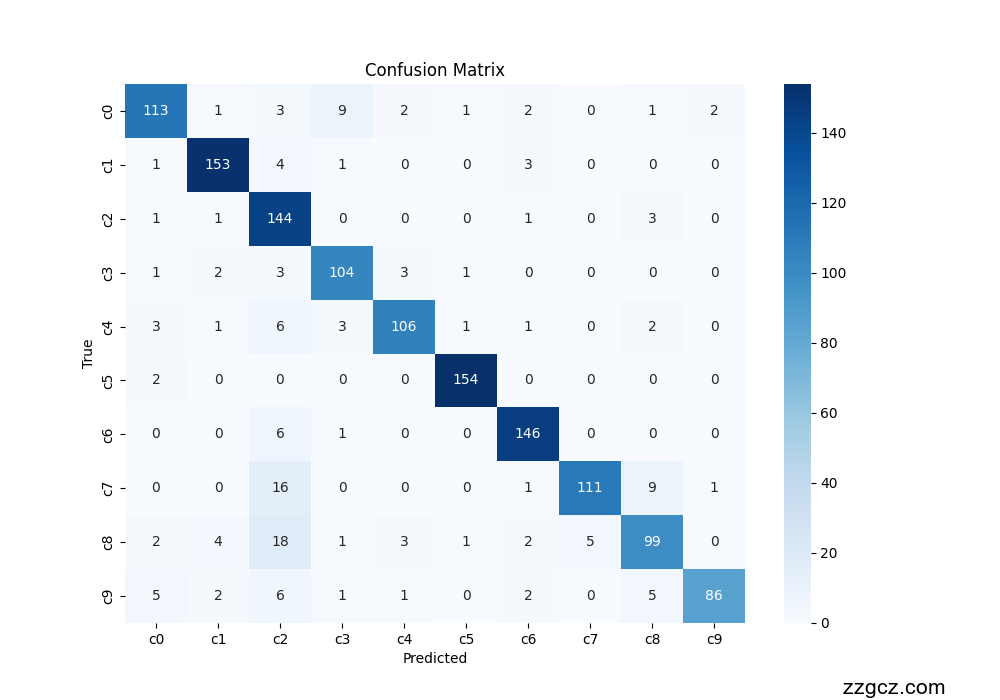

- 模型评估与结果可视化

评估模型时,主要计算模型的准确率,并通过混淆矩阵来分析模型的分类效果。混淆矩阵的可视化使用了seaborn模块,提供了更加直观的分类结果展示。

- 单张图片预测

为了测试模型的预测能力,我们提供了一个predict_image函数,用于输入一张图片并预测其分心行为类别。该函数将输入的图片转换为Tensor格式,并将其传递给训练好的模型进行预测。

mobilenet结果【下面的结果仅跑5轮测试,仅为展示结果。】:

cnn结果:

resnet结果: