A313-基于PatchTST的电力变压器温度长时间序列预测

导出时间:2025/11/26 14:33:16

【购买前必看】

1、关于我们

深度学习乐园是由python哥全职技术团队组建运营【团队成员为:复旦大学博士、华东理工爱丁堡博士、格拉斯哥博士、纽约大学硕士、浙江大学硕士】。

我们只做python业务,精通sklearn机器学习/torch深度学习/django/flask/vue全栈开发。

2、关于项目

我们从2018年开始,就专注于深度学习sci、ei、ccf、kaggle等,至今已有7年,共发表过10多篇顶刊顶会。

官网累积了数百个项目,已有3000多学员付费购买,圈子内有口皆碑:www.zzgcz.com (更多高级私密项目无法对外,联系微信定制:zzgcz_com)

3、售后承诺

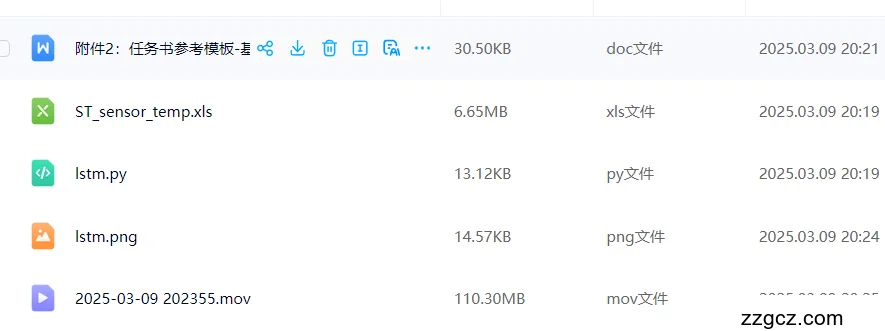

包远程安装调试,所有项目均在本地运行通过,大部分都有截图和录屏。

支持二次修改,所有项目都是我们自己写的,改起来也非常容易。

加急定制1-2天可完成,这就是实力证明,远程验收满意后再付全款!

所有客户终身售后。兼职的人家都有主业,谁愿意持续服务你?

注:此html可能格式或图片显示不全,请购买后查看docx文档

选题的意义

电力变压器温度的预测是为了电力系统安全生产运行和规划提出的一个时间序列预测问题,该问题不仅要基于已有数据提升未来数据预测的准确性,同时要考虑更长序列预测的因素。在实际的工程应用中,有着重要的应用价值。

二、研究内容和要求

1.主要研究内容:

通过Patch缩短时间序列长度表征序列的局部特征,利用Channel 独立的方式来处理多个单维时间序列,同时利用注意力机制捕捉不同Channel 的时间序列依赖关系,进而实现长时间序列预测。

了解卷积神经网络、递归神经网络;

熟悉多层感知器(Multi-Layer Perceptron);

熟悉神经网络前向传播和后向传播;

熟悉Transformer模型;

熟悉序列到序列的编解码架构;

基于PyTorch库,研究实现基于多层感知器、Transformer模型、序列到序列的编解码架构,应用于流感疾病就诊人数的长时间预测的PatchTST模型,改进序列到序列的编解码网络架构。

2.要求:

(1)学习通过查阅参考文献、视频资料等方式,熟悉研究内容,掌握研究方法;

(2)查阅与本课题相关资料 10 篇以上,学习、翻译至少一篇与研究内容相关的SCI顶刊外文资料;

(3)熟悉深度学习基本架构及实现原理;

(4)基于PyTorch库,通过Python实现相关算法并完成流感疾病就诊人数不同长时间序列的预测实验。

三、预期成果要求

刻苦努力钻研,积极参加讨论,经常答疑,认真做好笔记与心得,通过毕业论文的研究提高相关课题分析问题和解决问题的能力;

提升查阅理解文献、自主学习前沿知识、阅读/编写Python代码的能力,具备通过Python实现相关实验,提取实验数据;

培养学生通过机器学习、神经网络等知识解决现实问题的能力,同时启发学生对人工智能在现实工作、生活中可应用的思考;

严格按照“兰州工业学院本科生毕业设计(论文)撰写规范”的要求撰写论文,要使论文达到:论点明确,论据充分,结论正确,图表清晰,概念清楚,文理通顺,格式正确。

四、主要参考文献

Yuqi Nie, Nam H. Nguyen, Phanwadee Sinthong, Jayant Kalagnanam.A Time Series is Worth 64 Words: Long-term Forecasting with Transformers. In ICLR 2023.

Alexei Baevski, Yuhao Zhou, Abdelrahman Mohamed, and Michael Auli. wav2vec 2.0: A framework for self-supervised learning of speech representations. Advances in Neural InformationProcessing Systems, 33:12449–12460, 2020.

Shaojie Bai, J Zico Kolter, and Vladlen Koltun. An empirical evaluation of generic convolutionaland recurrent networks for sequence modeling. arXiv preprint arXiv:1803.01271, 2018.

Hangbo Bao, Li Dong, Songhao Piao, and Furu Wei. BEiT: BERT pre-training of image transformers. In International Conference on Learning Representations, 2022. URL https://openreview.net/forum?id=p-BhZSz59o4.

Rishi Bommasani, Drew A Hudson, Ehsan Adeli, Russ Altman, Simran Arora, Sydney von Arx,Michael S Bernstein, Jeannette Bohg, Antoine Bosselut, Emma Brunskill, et al. On the opportunities and risks of foundation models. arXiv preprint arXiv:2108.07258, 2021.